Los investigadores de Nvidia Corp. han anunciado una serie de innovaciones centradas en ayudar a los desarrolladores y artistas a combinar la inteligencia artificial con el software de gráficos por ordenador para dar vida a sus ideas creativas. Así nació Perfusion AI, un modelo de inteligencia artificial que permite crear imágenes a partir de descripciones en lenguaje natural, como DALL-E o el famoso Midjourney.

Así, si ya estábamos familiarizados con estas herramientas de inteligencia artificial, una más se une al equipo de la mano de Nvidia. Perfusion AI es capaz generar una imagen o incluir un objeto concreto con características específicas a través de texto, aunque es complicado que claramente nos aparezca el mismo objeto u obtengamos la resolución en forma de imagen que estábamos buscando con otras herramientas generativas. Esto podría cambiar con Perfusion.

No es una IA generadora de imágenes perfecta, claro está, aún estamos perfeccionando las herramientas de inteligencia artificial que han llegado con fuerza a nuestro mundo. Pero parece ser más precisa que sus competidores. Perfusion se basa en Stable Diffusion (un modelo de aprendizaje automático desarrollado por Runway y LMU Munic), pero con mecanismos adicionales para bloquear y generar múltiples «conceptos» en nuevas imágenes simultáneamente.

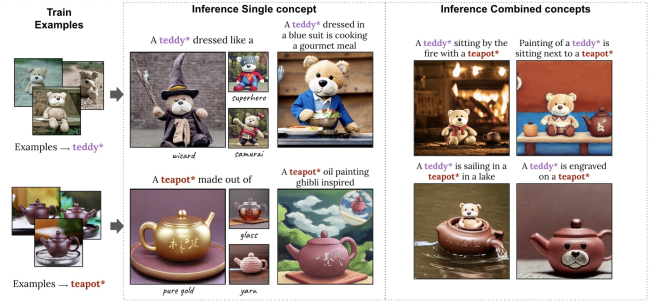

Perfusion permite a los usuarios combinar múltiples elementos personalizados con un puñado de imágenes conceptuales y crear imágenes más específicas generadas por IA. Lo que obtenemos a cambio es un rendimiento superior a las que herramientas de IA que ya conocemos al permitir un mayor control sobre el proceso de generación de imágenes. Mantener la fidelidad es un gran desafío para esos modelos generativos y, al mismo tiempo, permite crear nuevas imágenes en diferentes contextos.

Revolución de las imágenes generadas por IA

Esta nueva herramienta permitirá a los desarrolladores y artistas dar vida a sus ideas, ya sea fijas o en movimiento, en 2D o 3D, hiperrealistas o fantásticas. Hasta cerca de 20 artículos de investigación de NVIDIA que avanzan en la IA generativa y los gráficos neuronales, incluidas las colaboraciones con más de una docena de universidades en los EE. UU., Europa e Israel, se presentarán en SIGGRAPH 2023, el principal congreso de gráficos por ordenador que se celebrará del 6 al 10 de agosto en Los Ángeles.

Entre todos esos papers, se encuentran los que convierten el texto en imágenes personalizadas; herramientas de representación inversa que transforman imágenes fijas en objetos 3D; modelos de física neuronal que usan IA para simular elementos 3D complejos con un realismo sorprendente o modelos de representación neuronal que desbloquean nuevas capacidades para generar detalles visuales en tiempo real impulsados por IA, según explica la propia compañía Nvidia en su blog oficial.

Si tienes la suerte de poder acudir a este evento en Estados Unidos, te recordamos que NVIDIA también presentará seis cursos, cuatro charlas y dos demostraciones de tecnologías emergentes en la el gran evento del verano, con temas que incluyen seguimiento de rutas, telepresencia y modelos de difusión para IA generativa.

Respecto a Perfusion AI, que todavía no es perfecto, pero es un gran paso adelante para los modelos de texto a imagen con control total sobre la generación de recursos, por ahora, se desconoce cuándo estará disponible para su uso. Estaremos atentos a las novedades.